Google ponownie wkracza na rynek inteligentnych okularów, tym razem z poważniejszymi ambicjami niż kiedykolwiek. Nowa linia urządzeń oparta na platformie Android XR stawia na produktywność i praktyczne zastosowania, co wyraźnie odróżnia je od konkurencyjnych rozwiązań Meta, skoncentrowanych na mediach społecznościowych. Zamiast streamowania na żywo, Google proponuje narzędzia do pracy i codziennej organizacji.

Jak wynika z analizy Futurum, w ofercie znalazły się trzy odrębne modele, które różnią się zarówno możliwościami, jak i grupą docelową. Każdy z nich wykorzystuje zaawansowane systemy sztucznej inteligencji, w tym Gemini 2.5 Pro oraz wizyjny Project Astra. To właśnie te technologie odpowiadają za funkcje takie jak rozpoznawanie obiektów w czasie rzeczywistym czy pamięć kontekstowa, która zapamiętuje położenie przedmiotów i dostarcza o nich informacje na żądanie.

Trzy modele, trzy różne podejścia do noszonej AI

Google zdecydowało się na segmentację rynku, oferując produkty od podstawowych akcesoriów głosowych po zaawansowane zestawy dla deweloperów. Taka strategia ma objąć zarówno zwykłych użytkowników, jak i specjalistów poszukujących zaawansowanych narzędzi.

Gemini Audio Frames – dyskretny asystent w oprawkach

Najprostszy model wygląda jak zwykłe okulary korekcyjne, ale kryje w sobie kamery, mikrofony i asystenta głosowego. Gemini Audio Frames są przeznaczone dla osób, które chcą korzystać z AI bez zwracania na siebie uwagi. Sprawdzają się przy wydawaniu komend głosowych, szybkich wyszukiwaniach czy nawigacji audio.

Gemini Display Edition – informacje na wyciągnięcie oka

Dla profesjonalistów Google przygotowało wersję z monokularowym wyświetlaczem microLED. Okulary wyświetlają nawigację krok po kroku, powiadomienia i odpowiedzi AI bezpośrednio w polu widzenia użytkownika. To rozwiązanie skierowane do osób, które potrzebują stałego dostępu do danych bez odrywania wzroku od otoczenia.

Project Aura – piaskownica dla twórców aplikacji

Najbardziej zaawansowany model to zestaw deweloperski z pełnymi wyświetlaczami binocularnymi. Project Aura umożliwia tworzenie aplikacji przestrzennych i immersyjnych doświadczeń. Znajdzie zastosowanie w symulacjach szkoleniowych, projektowaniu przemysłowym i innych zaawansowanych przypadkach użycia w przedsiębiorstwach.

Jak Google łączy moc obliczeniową z komfortem noszenia

Sercem całego systemu jest Gemini 2.5 Pro, który współpracuje z Project Astra – systemem wizyjnym odpowiadającym za analizę otoczenia. Dzięki temu okulary nie tylko rozpoznają przedmioty, ale też zapamiętują ich lokalizację i kontekst. Użytkownik może na przykład zapytać, gdzie położył klucze, a AI wskaże ich ostatnie znane położenie.

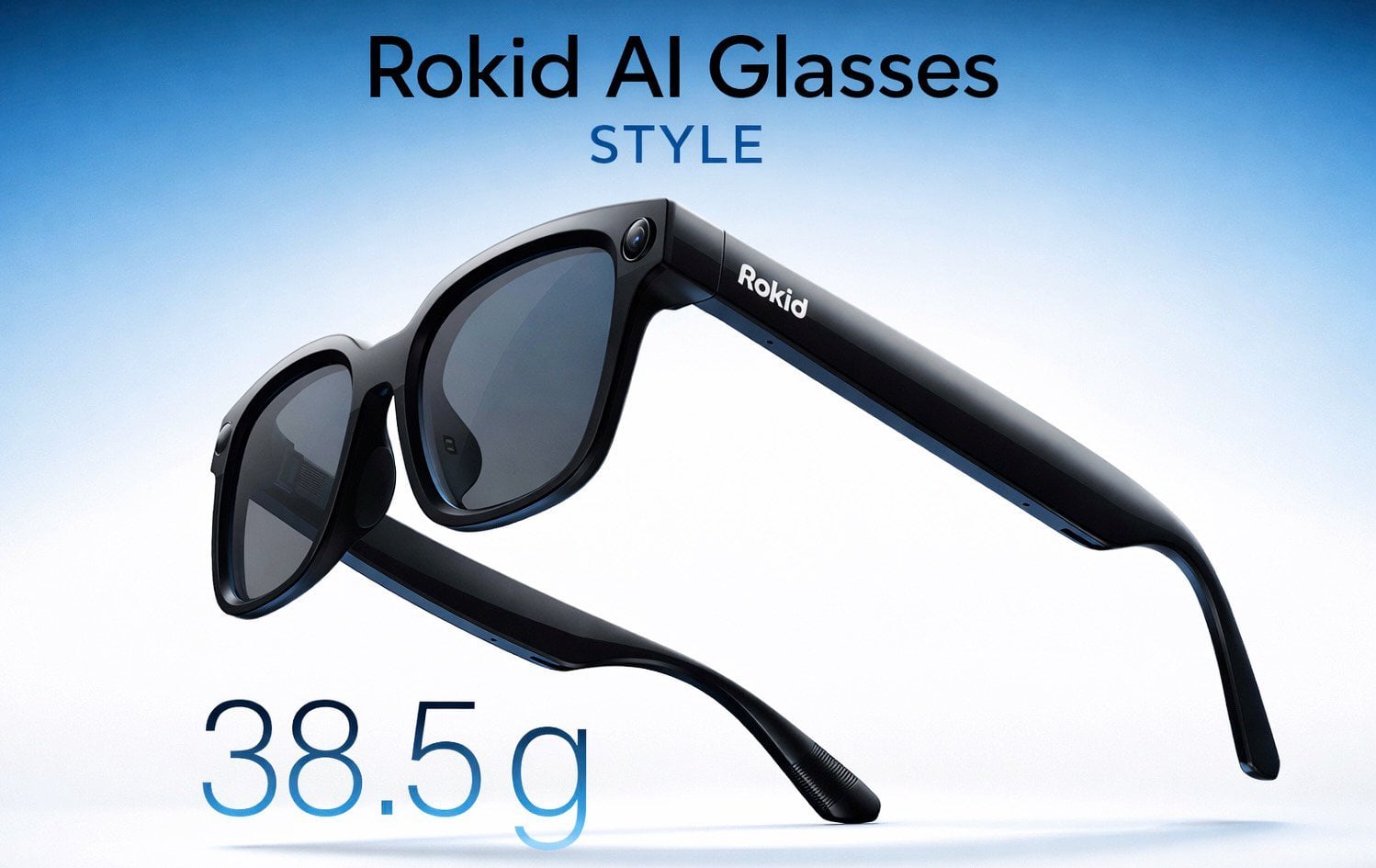

Aby zachować lekką konstrukcję, Google zastosowało architekturę rozproszonych obliczeń (split compute). Ciężkie zadania są odciążane do sparowanego smartfona lub chmury, co pozwala zachować wydajność bez zwiększania wagi okularów. Dodatkowym atutem jest narzędzie Nano Banana do edycji zdjęć w czasie rzeczywistym, które pokazuje wszechstronność urządzenia zarówno w pracy, jak i w życiu codziennym.

Prywatność i design – dwie strony tego samego medalu

Google zdaje sobie sprawę, że inteligentne okulary budzą obawy społeczne. Dlatego producent wdrożył kilka rozwiązań mających zwiększyć zaufanie użytkowników. Diody LED sygnalizują, kiedy kamera lub mikrofon są aktywne, a system minimalizacji wycieku dźwięku zapobiega podsłuchiwaniu prywatnych rozmów.

Równie ważny jest wygląd. Google nawiązało współpracę z markami Warby Parker i Gentle Monster, aby okulary nie kojarzyły się z ciężkim, technicznym gadżetem. Celem jest przełamanie stygmatyzacji noszenia elektroniki na twarzy i sprawienie, by urządzenie wyglądało jak modny dodatek.

Google kontra Meta – różne wizje noszonej technologii

Podczas gdy Meta stawia na funkcje społecznościowe, takie jak live streaming i tworzenie treści, Google kieruje swoje okulary do profesjonalistów. Integracja z Mapami Google, Workspace i Sklepem Play sprawia, że urządzenie staje się narzędziem pracy, a nie tylko gadżetem do rozrywki.

Kluczową przewagą konkurencyjną jest system Gemini 2.5 Pro, który według analityków lepiej rozumie kontekst rzeczywistego świata niż AI Meta oparta na modelu Llama. To przekłada się na bardziej praktyczne funkcje, takie jak wspomniane rozpoznawanie obiektów czy pamięć kontekstowa.

Rynek smart glasses czeka jednak kilka wyzwań. Analitycy wskazują na trzy główne bariery: sceptycyzm społeczny wynikający z obaw o prywatność, kwestie związane z gromadzeniem danych biometrycznych oraz wyzwania inżynieryjne, takie jak balansowanie między żywotnością baterii a lekką konstrukcją. Mimo to Google wydaje się dobrze przygotowane, by zdobyć znaczący udział w rynku, szczególnie w segmencie profesjonalnym i enterprise.

Nowe okulary Google ponownie otwierają dyskusję o tym, czy noszone urządzenia mogą zastąpić smartfony. Wpisują się one w szerszą wizję przetwarzania ambientowego, gdzie technologia staje się niewidocznym, naturalnym elementem otoczenia. Ostateczny sukces będzie jednak zależał od regulacji prawnych, szczególnie w obszarze ochrony danych biometrycznych, oraz od tego, czy użytkownicy zaakceptują noszenie komputerów na twarzy.