Świat otwartej sztucznej inteligencji właśnie otrzymał potężne wzmocnienie. DeepSeek 4, najnowsza rodzina modeli językowych, udowadnia, że open source wcale nie musi oznaczać kompromisów w wydajności. Dwa warianty – Pro i Flash – oferują parametry, które jeszcze niedawno były zarezerwowane dla zamkniętych, komercyjnych systemów. Największą rewolucją jest jednak okno kontekstowe o pojemności miliona tokenów, które pozwala modelom przetwarzać ogromne ilości tekstu za jednym razem.

Dwa modele, dwa różne zastosowania

DeepSeek 4 nie idzie na kompromis – zamiast jednego uniwersalnego modelu, twórcy oddają do rąk użytkowników dwie wyspecjalizowane wersje. Każda z nich została zaprojektowana z myślą o innych potrzebach obliczeniowych i budżetach.

Pro – siła dla wymagających zadań

Model Pro to prawdziwy ciężki zawodnik z 1,6 biliona parametrów. Taka skala sprawia, że radzi sobie znakomicie z zadaniami wymagającymi dużej precyzji i mocy obliczeniowej. Jeśli potrzebujesz analizować skomplikowane dane, generować rozbudowane treści czy rozwiązywać wieloetapowe problemy techniczne – to właśnie ten wariant będzie najlepszym wyborem.

Flash – wydajność w ograniczonym budżecie

Dla zespołów, które nie dysponują potężną infrastrukturą, DeepSeek przygotował model Flash. Jego 284 miliardy parametrów to wciąż imponująca wartość, ale przy znacznie niższych wymaganiach sprzętowych. Flash świetnie sprawdzi się w środowiskach, gdzie liczy się każdy wat mocy i każdy megabajt pamięci.

Oba modele łączy jedna kluczowa cecha – okno kontekstowe o długości 1 miliona tokenów. Dla porównania, to mniej więcej tyle, co trzy tomy „Wojny i pokoju” Tołstoja. Modele zostały wytrenowane na zbiorze danych liczącym około 32-33 bilionów tokenów, co przekłada się na ich wyjątkową zdolność adaptacji do różnorodnych zadań językowych.

Inżynieryjne perełki i oszczędności

Twórcy DeepSeek 4 położyli ogromny nacisk na efektywność. I to nie tylko w kontekście samej wydajności, ale także realnych oszczędności dla użytkowników.

Kompresja pamięci, która robi różnicę

Sercem innowacji w DeepSeek 4 jest technologia nazwana „compressed sparse attention”. To zaawansowana metoda optymalizacji pamięci podręcznej dla kluczy i wartości (key-value caching), która znacząco przyspiesza generowanie tokenów i redukuje obciążenie obliczeniowe. Dzięki temu modele działają płynnie nawet na mniej wydajnym sprzęcie, co otwiera drzwi do zastosowań, które wcześniej były poza zasięgiem otwartych rozwiązań.

Efekty są wymierne: model Pro zużywa o 27% mniej zasobów obliczeniowych w porównaniu do poprzednika. Z kolei Flash operuje przy zaledwie 10% FLOP-ów (operacji zmiennoprzecinkowych na sekundę) wcześniejszej wersji. To nie tylko szybsze działanie, ale przede wszystkim niższe koszty infrastruktury.

Otwartość i możliwość dostosowania

DeepSeek 4 pozostaje wierny idei open source. Wagi modeli, w tym wagi bazowe, są swobodnie dostępne do fine-tuningu. Deweloperzy mogą dostosować je do konkretnych potrzeb, co sprzyja współpracy i innowacjom w społeczności AI. To ważny krok – historycznie otwarte modele często odstawały od zamkniętych odpowiedników. DeepSeek 4 znacząco zmniejsza tę różnicę, oferując zaawansowane możliwości bez rezygnacji z dostępności.

Wsparcie sprzętowe i konkurencyjna cena

Jednym z największych wyzwań dla modeli AI jest kompatybilność z różnorodnym sprzętem. DeepSeek 4 przeszedł rygorystyczne testy na wielu platformach, w tym na kartach Nvidia oraz akceleratorach Havi Ascent NPU. Te drugie okazują się szczególnie opłacalną alternatywą dla zadań inferencyjnych, dając użytkownikom dodatkową elastyczność.

Model wyróżnia się także przejrzystą i przystępną strukturą cenową:

- Tokeny wejściowe: 0,15 dolara za milion

- Pominięcia pamięci podręcznej i tokeny wyjściowe: od 1,75 do 4 dolarów

- Darmowe testowanie: dostępne zarówno dla modeli Flash, jak i Pro

Taka polityka cenowa sprawia, że DeepSeek 4 staje się atrakcyjną opcją dla organizacji poszukujących wysokiej jakości rozwiązań AI bez ponoszenia astronomicznych kosztów.

Wyniki, zastosowania i plany na przyszłość

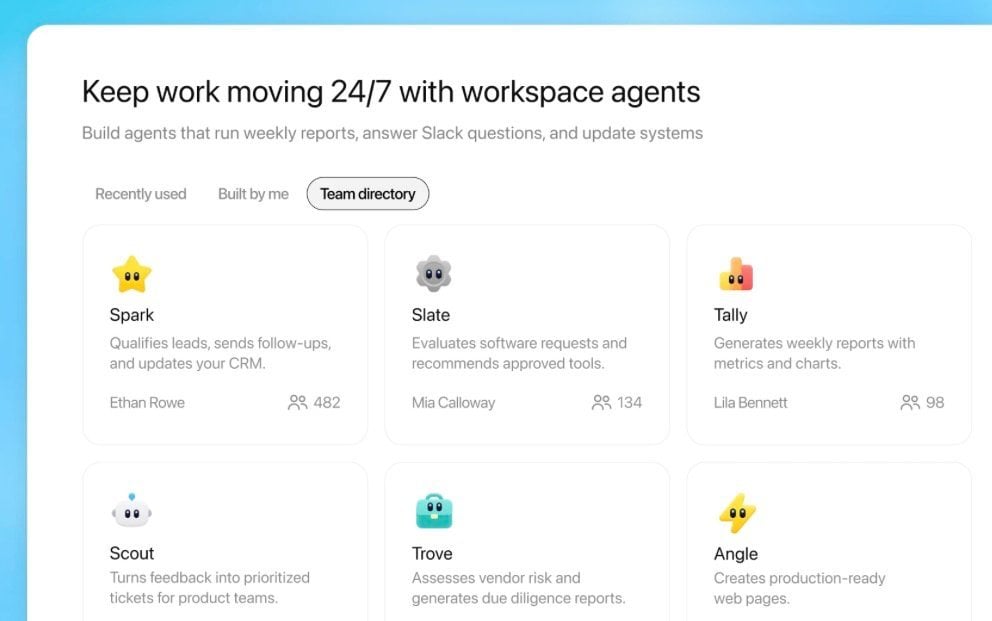

W testach porównawczych DeepSeek 4 wykazuje silne zdolności agencyjne – szczególnie w zadaniach wymagających planowania, wykonywania i adaptacji. Choć w kwestiach czystej wiedzy i rozumowania nieznacznie ustępuje konkurencji takiej jak Gemini 3.1, w zastosowaniach czasu rzeczywistego i przy złożonych instrukcjach radzi sobie znakomicie.

Potencjalne obszary zastosowań obejmują:

- Dynamiczne generowanie treści dla mediów i marketingu

- Automatyzację przepływów pracy opartych na API

- Wieloetapowe rozwiązywanie problemów w dziedzinach technicznych i kreatywnych

Należy jednak pamiętać, że jakość wyników w dużej mierze zależy od precyzji promptów. Niejasne lub zbyt uproszczone instrukcje mogą prowadzić do mniej dopracowanych rezultatów. To podkreśla wagę umiejętnego projektowania zapytań, aby w pełni wykorzystać potencjał modeli.

Wyzwania i kierunki rozwoju

DeepSeek 4 nie jest pozbawiony wad. Użytkownicy zgłaszają sporadyczne zatrzymania generowania tokenów podczas przejść między oknami kontekstowymi oraz pewne niedokładności w aplikacjach czasu rzeczywistego, szczególnie tych korzystających z wywołań API. Twórcy deklarują jednak, że te problemy zostaną rozwiązane w przyszłych aktualizacjach.

Plany rozwojowe są ambitne. Zapowiedziano wdrożenie 950 superwęzłów, co ma zwiększyć przepustowość usług i obniżyć koszty operacyjne. Kontynuowana będzie także integracja z zewnętrznymi systemami agencyjnymi, co otworzy drzwi do jeszcze bardziej zaawansowanych zastosowań w opiece zdrowotnej, finansach czy edukacji.

DeepSeek 4 to nie tylko kolejny model językowy. To sygnał, że otwarta sztuczna inteligencja wchodzi na nowy poziom – łącząc najnowsze osiągnięcia technologiczne z dostępnością i efektywnością. Dla badaczy, programistów i organizacji poszukujących innowacyjnych rozwiązań AI, to narzędzie, które warto mieć na radarze.