Świat modeli językowych nieustannie ewoluuje, a każda nowa iteracja obiecuje przełomowe możliwości. Najnowsza wersja, Opus 4.7, nie jest wyjątkiem, wprowadzając szereg udoskonaleń w kluczowych obszarach, od generowania kodu po analizę obrazów. Jednakże, jak wskazują analizy portalu Better Stack, te postępy niosą ze sobą istotny kompromis. Głównym wyzwaniem dla użytkowników może okazać się znaczący, bo sięgający nawet 35%, wzrost zużycia tokenów w niektórych konfiguracjach. To czyni z Opus 4.7 nie tylko narzędzie o ulepszonych parametrach, ale także obiekt wymagający przemyślanej strategii zarządzania kosztami, szczególnie przy dużych projektach.

Kluczowe ulepszenia wydajnościowe

Opus 4.7 koncentruje się na kilku fundamentalnych obszarach, które mają bezpośredni wpływ na codzienną pracę z modelem. Poprawy są wymierne i potwierdzone testami porównawczymi.

Większa efektywność w kodowaniu i weryfikacji

Dla programistów najistotniejsza będzie udoskonalona zdolność modelu do generowania kodu. Opus 4.7 tworzy go z większą dokładnością i mniejszą liczbą błędów, co może realnie przyspieszyć tempo rozwoju oprogramowania. Ponadto, model lepiej sprawdza i weryfikuje własne wyniki, co przekłada się na bardziej niezawodne rezultaty i mniej czasu poświęcanego na ręczne poprawki.

Trzykrotnie lepsza klarowność przetwarzania wizyjnego

Jednym z technologicznych skoków jest multimodalność. Zdolność do analizy obrazów została znacząco wzmocniona – nowa wersja oferuje potrójną klarowność w porównaniu z poprzednikami. To otwiera drzwi do bardziej zaawansowanych zadań łączących tekst i grafikę, takich jak szczegółowa interpretacja schematów, wykresów czy zrzutów ekranu.

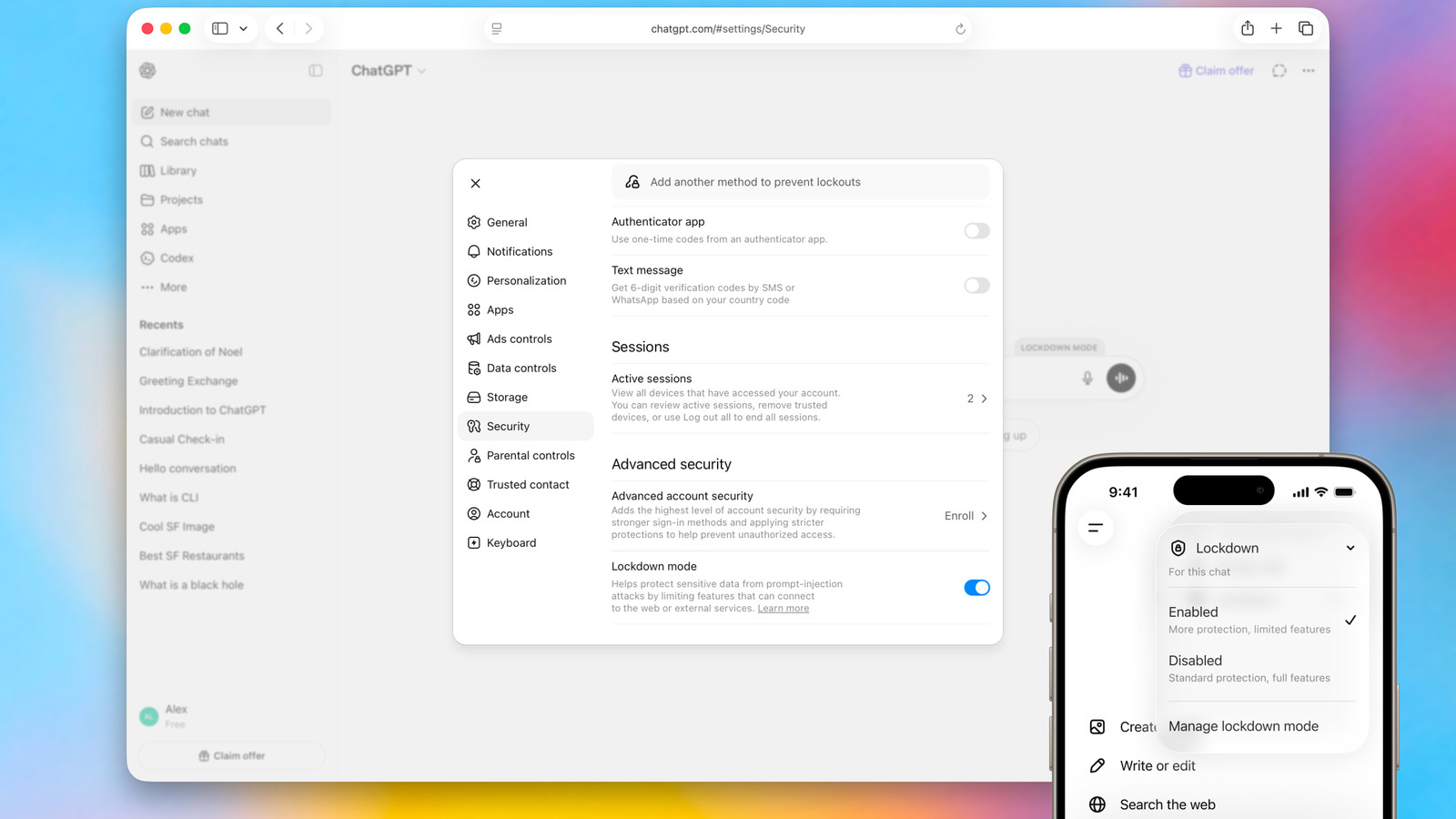

Intuicyjny interfejs i potwierdzone benchmarki

Nie zapomniano także o warstwie użytkownika. Odświeżony interfejs jest bardziej przystępny i wizualnie atrakcyjny, co ułatwia interakcję. Twarde dane, takie jak wyniki benchmarków SWBench Pro i Verified Benchmarks, pokazują odpowiednio 10% i 7% wzrostu wydajności, potwierdzając technologiczny postęp stojący za tymi udogodnieniami.

Tokenizer: między precyzją a kosztem

Sercem zmiany, która najbardziej wpłynie na portfele użytkowników, jest zaktualizowany tokenizer. To mechanizm odpowiedzialny za dzielenie i przetwarzanie tekstu na fragmenty zrozumiałe dla AI.

Dlaczego tokenów jest więcej?

Nowy tokenizer działa w bardziej wyrafinowany sposób. Dzięki temu model precyzyjniej rozumie niuanse językowe i złożone konstrukcje w dostarczanych mu promptach. Niestety, ta zwiększona szczegółowość analizy często wymaga użycia większej liczby tokenów do reprezentacji tego samego tekstu. Szczególnie dotyczy to domyślnego, nowego poziomu wysiłku „extra high”, zaprojektowanego dla maksymalnej jakości odpowiedzi.

Jak zarządzać tym wzrostem?

Dla osób zarządzających rozbudowanymi projektami lub ścisłymi budżetami, wzrost zużycia o 35% to istotny czynnik kosztowy. Kluczową strategią staje się świadome konfigurowanie ustawień modelu. Dostosowanie poziomu wysiłku czy długości kontekstu może pomóc znaleźć złoty środek między akceptowalną wydajnością a kontrolą nad wydatkami. Wymaga to jednak dodatkowej uwagi i ręcznego dostrojenia.

Inteligentniejsze instrukcje i pamięć kontekstu

Poza czystą mocą obliczeniową, Opus 4.7 rozwija się w kierunku lepszego „rozumienia” intencji użytkownika i zachowania płynności rozmowy.

Dosłowniejsze wykonywanie poleceń

Model stał się bardziej literalny w interpretacji promptów. Z jednej strony, to ogromna zaleta – lepiej dostosowuje wyniki do naszych dokładnych wymagań, redukując niejednoznaczność. Z drugiej strony, kładzie większą odpowiedzialność na użytkowniku: nieprecyzyjne lub źle sformułowane instrukcje mogą łatwiej prowadzić do nieoczekiwanych rezultatów. Skuteczne korzystanie z Opus 4.7 wymaga więc nieco więcej wprawy w klarownym komunikowaniu zadań.

Ulepszona pamięć i integracja multimodalna

W przypadku długich, wieloetapowych projektów przydatne okażą się ulepszenia pamięci. Model skuteczniej zachowuje kontekst z poprzednich interakcji, co minimalizuje potrzebę ciągłego przypominania mu założeń czy wcześniejszych decyzji. Połączenie tego z zaawansowanym przetwarzaniem wizyjnym tworzy spójne środowisko do pracy z danymi mieszanego typu, usprawniając cały proces.

Bezpieczeństwo i porównania z konkurencją

Anthropic wprowadziło do Opus 4.7 zaostrzone zabezpieczenia cybernetyczne. System aktywniej blokuje próby wysokiego ryzyka lub zabronione zapytania, stawiając na pierwszym miejscu bezpieczeństwo i zgodność z regulacjami. Ma to jednak swoją cenę – w specjalistycznych testach z dziedziny cyberbezpieczeństwa model może wykazywać nieco niższą wydajność. To świadomy kompromis na rzecz etyki i ochrony danych.

Gdy porównamy Opus 4.7 z jego poprzednią wersją, 4.6, nowy model przeważa w designie interfejsu, obsłudze TypeScript i ogólnej funkcjonalności. Jednak starsza iteracja może wciąż sprawdzać się lepiej w specyficznych scenariuszach, np. przy integracji z bazami danych. Na szerszym rynku, w zestawieniu z modelami takimi jak Gemini 3.1 czy GPT 5.4, Opus 4.7 utrzymuje silną pozycję, szczególnie w dziedzinach interfejsu i łączenia modalności.

Podsumowanie: kompromis, który warto przemyśleć

Opus 4.7 to bez wątpienia krok naprzód w ewolucji dużych modeli językowych. Jego mocne strony – ulepszone kodowanie, zaawansowana wizja, lepsze podążanie za instrukcjami i spójna pamięć – czynią go niezwykle atrakcyjnym narzędziem dla profesjonalistów. Nie można jednak przeoczyć związanych z nim kompromisów. Znaczny wzrost zużycia tokenów to realny czynnik kosztowy, a nieco ograniczona wydajność w bardzo długich kontekstach wymaga dodatkowej optymalizacji.

Ostatecznie, decyzja o aktualizacji do Opus 4.7 powinna być poprzedzona analizą konkretnych potrzeb i budżetu projektu. Dla zespołów, gdzie precyzja i zaawansowane możliwości multimodalne są priorytetem, a koszty tokenów można zaplanować, nowa wersja oferuje wyraźną wartość. Dla innych, bardziej wrażliwych na budżet, pozostanie przy starszych konfiguracjach lub drobiazgowe dostrojenie ustawień Opus 4.7 może być rozsądniejszą strategią. To model, który nagradza świadome i przemyślane korzystanie.