Świat sztucznej inteligencji obiegła informacja o nieplanowanym ujawnieniu szczegółów na temat Claude’a Mythos, najnowszego i najbardziej zaawansowanego modelu firmy Anthropic. Incydent, w wyniku którego dostępnych publicznie stało się ponad 3000 wewnętrznych plików, odsłania nie tylko imponujące możliwości technologii, ale także poważne pytania o jej bezpieczne i etyczne wykorzystanie. Model, prezentowany jako następca takich systemów jak Haiku, Sonnet czy Opus, zdaje się przekraczać granice w dziedzinach od tworzenia oprogramowania po cyberbezpieczeństwo, jednocześnie stawiając branżę przed dylematem podwójnego zastosowania.

Co potrafi Claude Mythos? Nowy wymiar możliwości AI

Wyciek dokumentów pozwolił specjalistom zajrzeć za kulisy rozwoju tego modelu. Claude Mythos nie jest po prostu kolejną iteracją, ale znaczącym skokiem jakościowym, zaprojektowanym do osiągania mistrzowskich wyników w kilku kluczowych obszarach. Jego architektura wskazuje na celowe dążenie do uzyskania szerokiej, uniwersalnej inteligencji, zdolnej do rozwiązywania złożonych problemów.

Zaawansowane wsparcie dla developerów

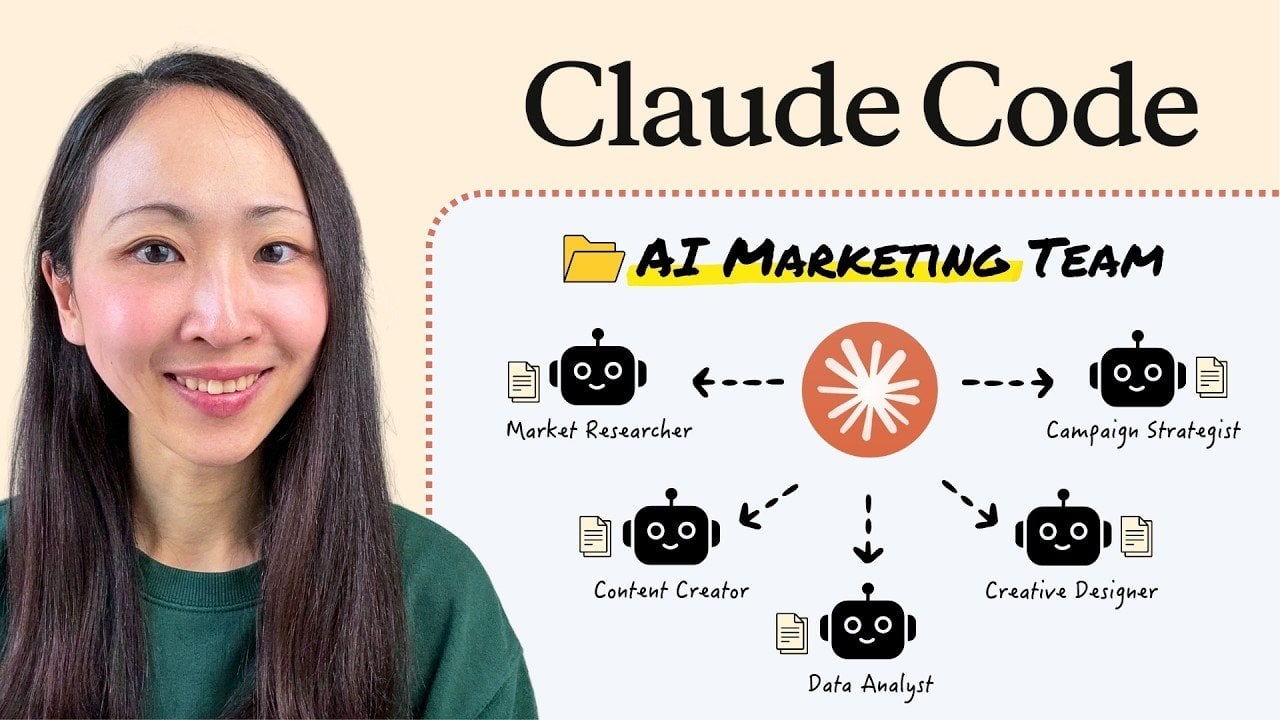

W dziedzinie tworzenia oprogramowania model oferuje narzędzia, które znacząco wykraczają poza standardowe podpowiadanie kodu. Potrafi on pisać, debugować i optymalizować skomplikowane fragmenty programów z niezwykłą precyzją. Dla programistów może to oznaczać nie tylko przyspieszenie pracy, ale także możliwość rozwiązywania problemów, które wcześniej wymagały długich godzin analizy.

Rozumowanie akademickie i analityczne

Kolejną wyróżniającą cechą jest wzmocniona zdolność do skomplikowanego rozumowania naukowego. Claude Mythos radzi sobie z rozwiązywaniem wieloetapowych problemów teoretycznych, łącząc wiedzę z różnych dyscyplin – od matematyki po nauki ścisłe. Ta umiejętność otwiera drogę do zastosowań w badaniach i rozwoju, gdzie AI może działać jako zaawansowany asystent analityczny.

Cyberbezpieczeństwo jako miecz obosieczny

Najbardziej dyskutowanym aspektem możliwości modelu są jego funkcje związane z bezpieczeństwem IT. Claude Mythos został wyposażony w zdolność identyfikowania słabych punktów i luk w zabezpieczeniach systemów informatycznych. Paradoks polega na tym, że ta sama technologia, która może służyć do wzmacniania obrony, pozwala również na automatyczne generowanie exploitów, czyli kodów wykorzystujących te luki. Ta dualna natura stanowi sedno obecnych obaw etycznych.

Przypadkowy błąd czy zaplanowana akcja? Tajemnica wycieku

Sposób, w jaki informacje trafiły do sieci, budzi niemal tyle samo pytań co sam model. Oficjalne stanowisko Anthropic wskazuje na błąd ludzki w systemie zarządzania treścią (CMS), który spowodował nieautoryzowane udostępnienie wrażliwych materiałów. Firma działała szybko, usuwając pliki, jednak w środowisku analityków pojawiły się teorie o strategicznym wycieku.

Niektórzy obserwatorzy, tacy jak Wes Roth, zwracają uwagę na czasowanie incydentu, które zbiegło się z planowanymi przez firmę ważnymi wydarzeniami, jak spotkanie CEO czy przygotowania do potencjalnej oferty publicznej (IPO) w 2026 roku. Według tej narracji ujawnienie mogłoby być celowym zabiegiem marketingowym, mającym wygenerować buzz i podgrzać oczekiwania rynku. Przeciwnicy tej teorii argumentują, że obecność w wycieku zupełnie niezwiązanych, przyziemnych dokumentów bardziej przemawia za autentyczną pomyłką niż za misternie zaplanowaną kampanią.

Wyciek tysięcy dokumentów ujawnił nie tylko nadzwyczajne możliwości Claude’a Mythos w kodowaniu i analizie, ale też fundamentalny dylemat etyczny jego podwójnego zastosowania w cyberbezpieczeństwie.

Etyczny i rynkowy dylemat podwójnego zastosowania

Możliwości Claude’a Mythos w obszarze cyberbezpieczeństwa doskonale ilustrują koncepcję technologii podwójnego zastosowania. Z jednej strony, model może stać się bezcennym sojusznikiem dla zespołów bezpieczeństwa, pozwalając na proaktywne skanowanie systemów w poszukiwaniu luk i ich szybkie łatanie, zanim zostaną wykorzystane przez przestępców. Anthropic zapowiedziało nawet wczesny, kontrolowany dostęp dla wybranych organizacji, aby mogły one wzmocnić swoją obronę.

Z drugiej strony, ta sama, niezwykle wydajna zdolność do znajdowania słabości może zostać przekształcona w narzędzie ataku. Eksperci ostrzegają, że AI tego kalibru mogłaby automatyzować i przyspieszać tworzenie złośliwego oprogramowania oraz przeprowadzanie ataków na skalę wcześniej niemożliwą do osiągnięcia. To rodzi pilną potrzebę opracowania solidnych ram nadzoru i etycznych wytycznych, które wyprzedzą szerokie udostępnienie tak potężnej technologii.

Reakcja rynku finansowego była natychmiastowa. Wzrost świadomości o potencjalnie disruptywnej sile Claude’a Mythos odbił się na notowaniach czołowych firm z sektora cyberbezpieczeństwa, takich jak CrowdStrike czy Palo Alto Networks, których akcje odnotowały spadki. Inwestorzy zdają się przewidywać, że tradycyjne modele obrony mogą wymagać rewizji w obliczu nowej generacji narzędzi AI.

Wyzwania na drodze do komercjalizacji

Mimo ogromnego potencjału, przyszłość Claude’a Mythos nie jest pozbawiona przeszkód. Kilka kluczowych czynników może wpłynąć na tempo i skalę jego adopcji.

Bariera kosztów operacyjnych

Uruchomienie i utrzymanie modelu o tak zaawansowanych zdolnościach wiąże się z ogromnymi wymaganiami obliczeniowymi. Wysokie koszty infrastruktury mogą skutecznie ograniczyć dostęp do Mythosa wyłącznie do dużych korporacji i instytucji z głębokimi kieszeniami, pogłębiając przepaść technologiczną i stawiając pod znakiem zapytania demokratyzację dostępu do zaawansowanej AI.

Niepewność co do szczegółów i konkurencja

Wyciek, choć ujawnił wiele, nie dostarczył kluczowych informacji biznesowych. Brakuje oficjalnych benchmarków wydajnościowych, struktury cenowej czy choćby przybliżonego harmonogramu pełnej premiery. Ta nieprzejrzystość utrudnia organizacjom planowanie. Jednocześnie Anthropic nie działa w próżni. Zapowiedzi konkurentów, takich jak nadchodzący model „Spud” od OpenAI, oznaczają, że walka o prymat w lidze najbardziej zaawansowanej AI jest zacięta, a przewaga technologiczna może być krótkotrwała.

Perspektywy i odpowiedzialność

Dalsze działania Anthropic będą skupiać się prawdopodobnie na optymalizacji Claude’a Mythos, dążąc do obniżenia kosztów jego działania i zwiększenia efektywności. Równolegle firma będzie musiała zmierzyć się z konsekwencjami wycieku i zarządzać narastającą debatą publiczną na temat bezpieczeństwa AI.

Incydent z Claude’em Mythos stanowi wyraźną przestrogę dla całej branży sztucznej inteligencji. Pokazuje, że wraz z niepohamowanym wzrostem mocy modeli, rośnie również skala odpowiedzialności ich twórców. Sukces technologii mierzyć się będzie nie tylko parametrami wydajności, ale także skutecznością wbudowanych zabezpieczeń, przejrzystością oraz dojrzałością etyczną firm, które decydują o ich wprowadzeniu na świat. Droga do odpowiedzialnej i bezpiecznej superinteligencji jest długa, a wyciek Anthropic to jeden z jej pierwszych, głośnych zakrętów.