Generowanie wideo przez sztuczną inteligencję wkracza na nowy, osobisty poziom. Najnowsza wersja modelu OpenAI, Sora 2, wprowadza funkcję o nazwie Character Cameo, która pozwala umieszczać w wygenerowanych filmach… niemal wszystko, co nas otacza. Chodzi o wykorzystanie krótkiego nagrania naszego pupila, ulubionego przedmiotu czy nawet wymyślonej postaci do stworzenia unikalnych, animowanych scen. Dla miłośników zwierząt i kreatywnych eksperymentów z AI to prawdziwa rewolucja.

Czym jest Character Cameo w Sora 2?

Character Cameo to mechanizm, który przekształca zwykłe, kilkusekundowe nagranie w cyfrowego „aktora”. Ten aktor może następnie zostać obsadzony w dowolnej scenie opisanej przez użytkownika za pomocą tekstowego polecenia. Funkcja jest szczególnie atrakcyjna dla właścicieli zwierząt domowych, którzy marzą, by ich kot wystąpił w filmie science-fiction lub pies przemówił ludzkim głosem. Ale możliwości są szersze – można ożywić zabawkę, wazon czy inną personifikowaną rzecz.

Jak rozpocząć pracę z funkcją?

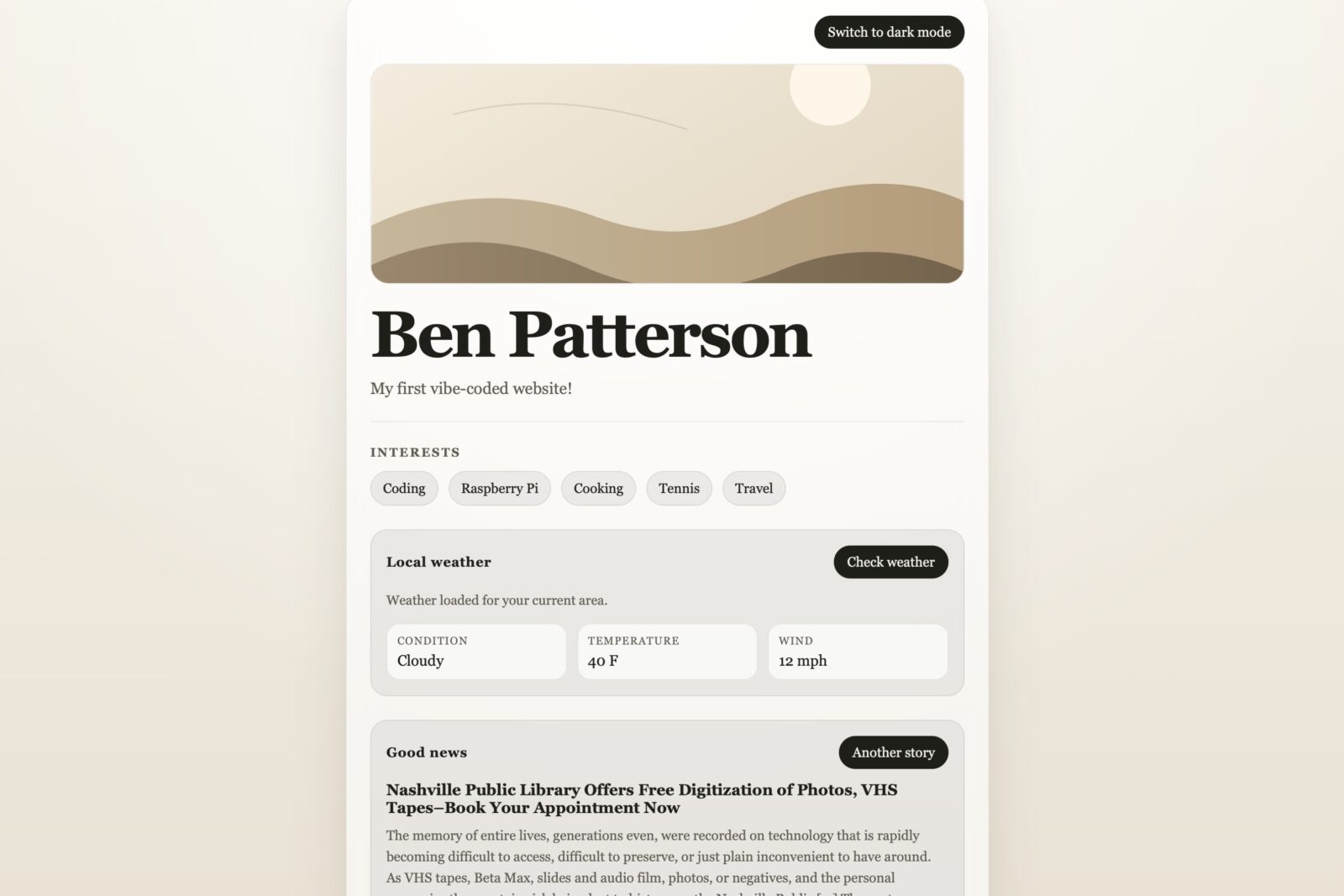

Aby skorzystać z Character Cameo, potrzebne jest konto w ChatGPT. Wystarczy wersja darmowa, jednak subskrypcja Plus lub Pro odblokuje dodatkowe możliwości. Sam proces tworzenia odbywa się poprzez stronę internetową Sora lub jej aplikację na iOS. Wersja na Androida nie obsługuje jeszcze tej funkcji, ale według informacji ma to się wkrótce zmienić. Po zalogowaniu się na wybranej platformie użytkownik decyduje o zakresie widoczności tworzonego „charakteru”. Może on być prywatny, udostępniony wybranym osobom, wzajemnym obserwującym lub publiczny dla wszystkich użytkowników Sory.

Krok po kroku: Tworzenie własnego bohatera wideo

Przygotowanie materiału źródłowego

Pierwszym etapem jest nagranie klipu wideo z wybranym obiektem lub zwierzęciem. Eksperci zalecają, by film trwał od 3 do 10 sekund. Kluczowe jest, aby główny „bohater” był dobrze widoczny przez cały czas trwania ujęcia. W przypadku zwierząt warto nagrywać na poziomie ich oczu, uchwycić naturalny ruch, taki jak chodzenie, siadanie czy odwracanie głowy. Dla przedmiotów istotna jest stabilność kamery – należy unikać gwałtownych przesunięć. Nagranie można zapisać w popularnych formatach, takich jak MP4, MOV czy AVI.

Przesłanie i konfiguracja postaci

Po przygotowaniu materiału, w interfejsie Sory (strona lub aplikacja) należy przejść do zakładki profilu i wybrać opcję „Utwórz postać” (lub „Create character”). Następnie przesyła się plik wideo. System oferuje możliwość przycięcia klipu, aby wybrać najlepszy fragment. Po zaakceptowaniu nagrania, Sora automatycznie przypisze postaci nazwę użytkownika i wyświetlaną, które można dowolnie zmienić. Można też edytować lub usunąć automatycznie wygenerowany opis. Ostatnim krokiem w tym etapie jest wybór widoczności postaci oraz ustawienie preferencji, takich jak rodzaj zaimka, szczegółowy opis czy ewentualne ograniczenia w jej wykorzystaniu.

Generowanie spersonalizowanego filmu z nowym bohaterem

Gdy postać jest już gotowa, można ją „obsadzić” w filmie. W polu tekstowym, w którym opisuje się scenę, wystarczy wpisać znak „@” i rozpocząć nazwę stworzonego charakteru, a następnie wybrać go z listy. Potem należy szczegółowo opisać, co ma się dziać w wideo. Przed wysłaniem polecenia warto skorzystać z ustawień, by wybrać orientację (pionową lub poziomą) oraz długość generowanego materiału.

Praktyczne wyzwania i wskazówki

Tworzenie idealnego filmu może wymagać kilku prób i doprecyzowania poleceń. Autor artykułu, Lance Whitney, testując funkcję na swoim kocie Mr. Giggles, zauważył, że Sora jest bardzo wrażliwa na treści, które mogą naruszać prawa autorskie. Na przykład, prośba o wygenerowanie sceny z kotem-superbohaterem musi zawierać wyraźne zastrzeżenie, że postać nie ma przypominać żadnej istniejącej franczyzy. W przeciwnym razie model może odmówić generacji. Whitney radzi, by w tworzeniu precyzyjnych opisów scen (promptów) pomagał się innym modelem AI, takim jak ChatGPT, co pomaga uniknąć częstych pułapek.

Ostatecznie oba wygenerowane filmy ożywiły Mr. Gigglesa w sposób, którego wcześniej nie mogłem sobie wyobrazić – podsumowuje swoje doświadczenia Lance Whitney.

W jego testach Mr. Giggles najpierw wystąpił jako latający superbohater w stroju i pelerynie, a w drugim filmie – w realistycznej kuchennej scenie – poprosił ludzkim głosem o swoją ulubioną kolację. Oba filmy, mimo pewnych trudności w precyzyjnym sterowaniu efektem, zaskoczyły realizmem i kreatywnym potencjałem.

Perspektywy i ograniczenia personalizacji wideo AI

Funkcja Character Cameo w Sora 2 pokazuje wyraźny kierunek rozwoju generatywnego wideo: ku większej personalizacji i interakcji z otoczeniem użytkownika. To nie tylko zabawa, ale też narzędzie dla twórców treści, edukatorów czy marketingu, którzy chcą budować unikalne, angażujące historie z udziałem rozpoznawalnych „bohaterów”. Jednocześnie, jak pokazują doświadczenia, technologia ta wciąż wymaga od użytkownika pewnej wprawy w formułowaniu poleceń i świadomości ograniczeń związanych z prawami autorskimi. OpenAI stopniowo rozwiązuje te kwestie, o czym świadczy niedawna umowa z Disneyem, pozwalająca na wykorzystanie w Sora ponad 200 postaci z ich uniwersum.

Character Cameo to krok w stronę demokratyzacji zaawansowanej produkcji wideo, gdzie każdy, przy odrobinie cierpliwości, może stać się reżyserem filmów z udziałem swoich najbliższych – nawet jeśli są to czworonożni członkowie rodziny. Przyszłość pokaże, jak tego typu funkcje wpłyną na nasze postrzeganie treści wideo i gdzie przebiegnie granica między cyfrową rozrywką a personalną ekspresją.