Gemma 3: Najpotężniejszy model AI, który uruchomisz na pojedynczym GPU lub TPU

Google DeepMind wprowadza na rynek Gemma 3 – kolekcję lekkich, najnowocześniejszych modeli open source, stworzonych na bazie tej samej technologii, która napędza modele Gemini 2.0. To najbardziej zaawansowane, przenośne i odpowiedzialnie opracowane modele otwarte, jakie do tej pory powstały w Google.

Jak Gemma zrewolucjonizowała świat AI w zaledwie rok

W ostatnim miesiącu Google DeepMind świętował pierwsze urodziny Gemmy – kamień milowy, który został zaznaczony niesamowitą adopcją tego modelu. Ponad 100 milionów pobrań i tętniąca życiem społeczność, która stworzyła ponad 60 000 wariantów Gemmy, są dowodem na to, jak wielki wpływ miał ten projekt na rozwój otwartych modeli AI.

Dziś rodzina modeli Gemma wkracza na nowy poziom z Gemma 3 – kolekcją zaprojektowaną do szybkiego działania bezpośrednio na urządzeniach, od telefonów i laptopów po stacje robocze. Modele te mają pomóc deweloperom tworzyć aplikacje AI wszędzie tam, gdzie są potrzebne. Gemma 3 jest dostępna w różnych rozmiarach (1B, 4B, 12B i 27B), co pozwala wybrać model najlepiej dopasowany do konkretnego sprzętu i potrzeb wydajnościowych.

Jakie nowe możliwości oferuje Gemma 3 deweloperom

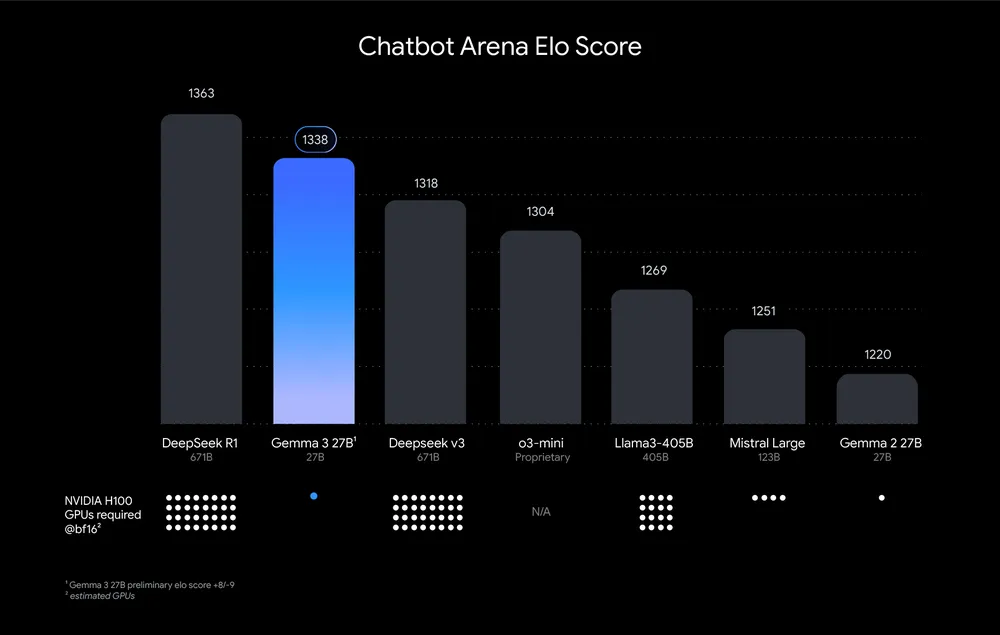

Gemma 3 to przełom w dziedzinie modeli AI, które można uruchomić na pojedynczym akceleratorze. Model ten przewyższa Llama-405B, DeepSeek-V3 i o3-mini w wstępnych ocenach preferencji użytkowników na tablicy wyników LMArena. Co to oznacza w praktyce? Deweloperzy mogą tworzyć angażujące doświadczenia użytkownika, które mieszczą się na pojedynczym GPU lub TPU.

Jedną z najbardziej imponujących cech Gemma 3 jest wsparcie językowe. Model oferuje natychmiastową obsługę ponad 35 języków i wstępne wsparcie dla ponad 140 języków, co pozwala tworzyć aplikacje, które „mówią” w języku klientów z całego świata.

Gemma 3 przewyższa modele wymagające nawet 32 razy więcej zasobów, oferując najlepszą w swojej klasie wydajność na pojedynczym GPU.

Oprócz zaawansowanego przetwarzania tekstu, Gemma 3 posiada również zaawansowane możliwości rozumowania wizualnego. Deweloperzy mogą z łatwością budować aplikacje analizujące obrazy, tekst i krótkie filmy, co otwiera nowe możliwości dla interaktywnych i inteligentnych zastosowań.

Dla zadań wymagających przetwarzania dużych ilości danych, Gemma 3 oferuje rozszerzony kontekst 128 tysięcy tokenów. Pozwala to aplikacjom przetwarzać i rozumieć ogromne ilości informacji jednocześnie.

Model wspiera również wywoływanie funkcji (function calling) i strukturyzowane wyjście, co pomaga w automatyzacji zadań i budowaniu doświadczeń agentowych. A dla tych, którzy potrzebują jeszcze większej wydajności, Gemma 3 wprowadza oficjalne wersje kwantyzowane, które zmniejszają rozmiar modelu i wymagania obliczeniowe przy zachowaniu wysokiej dokładności.

Jak Google DeepMind zapewnia odpowiedzialny rozwój modeli Gemma 3

Google DeepMind przykłada ogromną wagę do odpowiedzialnego rozwoju swoich modeli AI. Firma wierzy, że modele open source wymagają starannej oceny ryzyka, a ich podejście równoważy innowacyjność z bezpieczeństwem – dostosowując intensywność testów do możliwości modelu.

Rozwój Gemma 3 obejmował rozbudowane zarządzanie danymi, dostosowanie do polityk bezpieczeństwa poprzez fine-tuning oraz solidne oceny porównawcze. Choć szczegółowe testowanie bardziej zaawansowanych modeli często informuje o ocenie tych mniej zaawansowanych, zwiększona wydajność STEM Gemma 3 wymagała specyficznych ocen skupionych na potencjalnym niewłaściwym wykorzystaniu do tworzenia szkodliwych substancji – wyniki tych testów wskazują na niski poziom ryzyka.

W miarę jak branża rozwija coraz potężniejsze modele, kluczowe będzie wspólne opracowanie podejść do bezpieczeństwa proporcjonalnych do ryzyka. Google DeepMind zobowiązuje się do dalszego doskonalenia swoich praktyk bezpieczeństwa dla modeli open source.

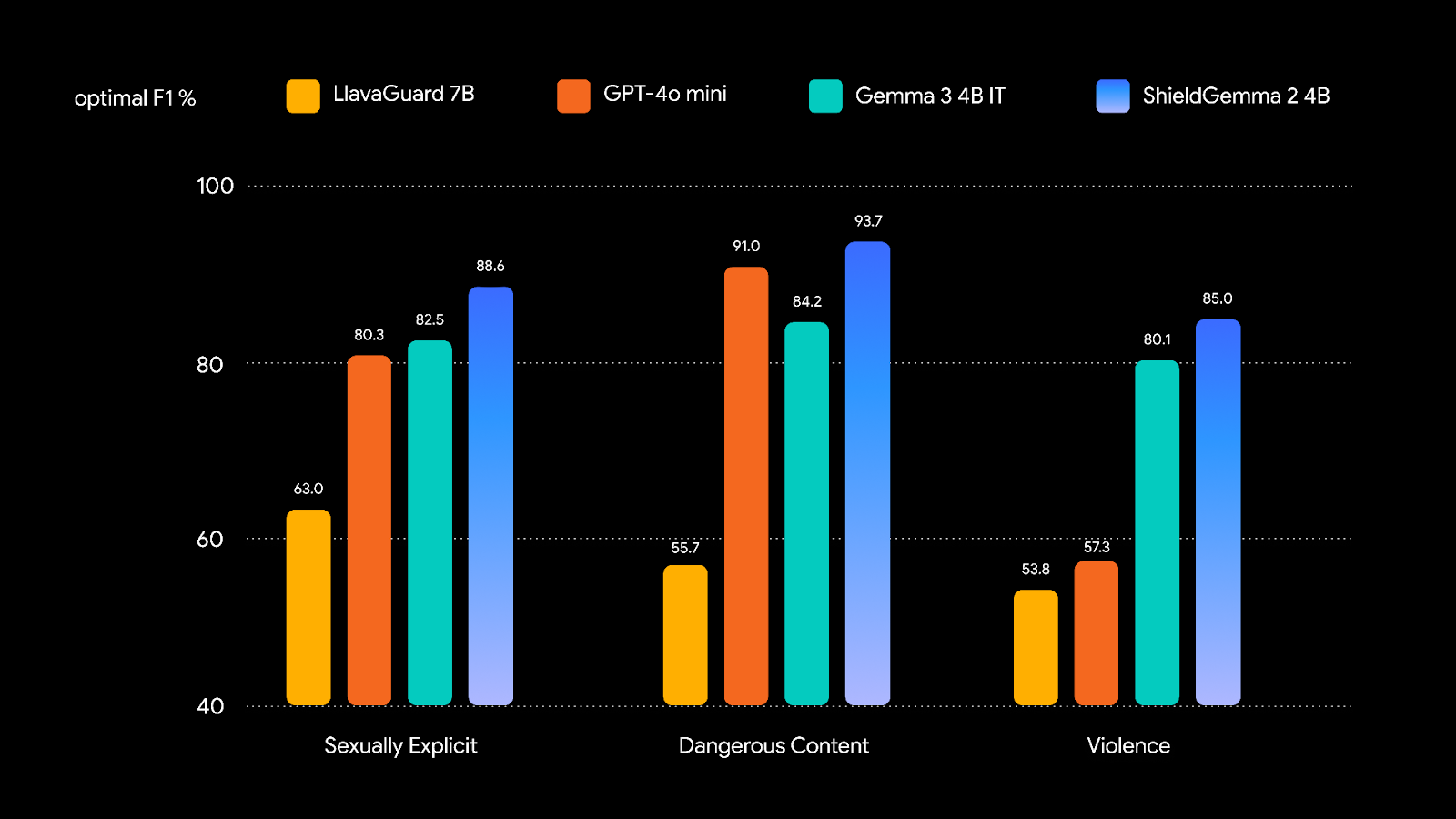

Jak ShieldGemma 2 zapewnia bezpieczeństwo aplikacji obsługujących obrazy

Wraz z Gemma 3 Google DeepMind wprowadza ShieldGemma 2 – potężny 4-miliardowy model sprawdzający bezpieczeństwo obrazów, zbudowany na fundamencie Gemma 3. ShieldGemma 2 zapewnia gotowe rozwiązanie dla bezpieczeństwa obrazów, generując etykiety bezpieczeństwa w trzech kategoriach: niebezpieczna zawartość, treści jawnie seksualne i przemoc.

Deweloperzy mogą dalej dostosowywać ShieldGemma do swoich potrzeb bezpieczeństwa i użytkowników. Model ten jest otwarty i zbudowany z myślą o elastyczności i kontroli, wykorzystując wydajność i efektywność architektury Gemma 3 do promowania odpowiedzialnego rozwoju AI.

ShieldGemma 2 to otwarty model bezpieczeństwa, który pozwala deweloperom skutecznie filtrować niebezpieczne obrazy w trzech kluczowych kategoriach ryzyka.

Jak łatwo zintegrować Gemma 3 z narzędziami, których już używasz

Gemma 3 i ShieldGemma 2 integrują się bezproblemowo z istniejącymi przepływami pracy deweloperów. Modele wspierają popularne narzędzia takie jak Hugging Face Transformers, Ollama, JAX, Keras, PyTorch, Google AI Edge, UnSloth, vLLM i Gemma.cpp, dając elastyczność wyboru najlepszych narzędzi dla projektu.

Deweloperzy mogą rozpocząć eksperymenty w kilka sekund, uzyskując natychmiastowy dostęp do Gemma 3 i rozpoczynając budowę swoich aplikacji. Mogą eksplorować pełny potencjał modelu w Google AI Studio lub pobrać modele przez Kaggle lub Hugging Face.

Gemma 3 jest dostarczana z odświeżoną bazą kodu, która zawiera przepisy na wydajne dostrajanie i wnioskowanie. Można trenować i adaptować model przy użyciu preferowanej platformy, takiej jak Google Colab, Vertex AI, a nawet karty graficznej do gier.

Model oferuje również wiele opcji wdrażania, w tym Vertex AI, Cloud Run, Google GenAI API, środowiska lokalne i inne platformy, dając elastyczność wyboru najlepszego dopasowania do aplikacji i infrastruktury.

Jak społeczność Gemma rozwija ekosystem narzędzi AI

„Gemmaverse” to rozległy ekosystem modeli i narzędzi tworzonych przez społeczność Gemma, gotowych do zasilania i inspirowania innowacji. Na przykład, SEA-LION v3 od AI Singapore przełamuje bariery językowe i wspiera komunikację w Azji Południowo-Wschodniej; BgGPT od INSAIT to pionierski bułgarski model językowy, który demonstruje moc Gemma we wspieraniu różnorodnych języków; a OmniAudio od Nexa AI pokazuje potencjał AI na urządzeniach, przynosząc zaawansowane możliwości przetwarzania audio do codziennych urządzeń.

Aby promować produkty w badaniach akademickich, Google DeepMind uruchamia Program Akademicki Gemma 3. Badacze akademiccy mogą ubiegać się o kredyty Google Cloud (o wartości 10 000 dolarów na nagrodę), aby przyspieszyć swoje badania oparte na Gemma 3. Formularz zgłoszeniowy jest już otwarty i pozostanie aktywny przez cztery tygodnie.

Gemmaverse to już ponad 60 000 wariantów i 100 milionów pobrań w ciągu zaledwie roku, co pokazuje skalę wpływu otwartych modeli AI na innowacje.

Jak rozpocząć pracę z Gemma 3

Jako część ciągłego zaangażowania Google DeepMind w demokratyzację dostępu do wysokiej jakości AI, Gemma 3 reprezentuje kolejny krok w tej misji. Dla tych, którzy chcą eksplorować Gemma 3, Google DeepMind sugeruje następujące kroki:

Natychmiastowa eksploracja:

- Wypróbuj Gemma 3 z pełną precyzją bezpośrednio w przeglądarce – bez konieczności konfiguracji – z Google AI Studio.

- Uzyskaj klucz API bezpośrednio z Google AI Studio i używaj Gemma 3 z Google GenAI SDK.

Dostosowywanie i budowanie:

- Pobierz modele Gemma 3 z Hugging Face, Ollama lub Kaggle.

- Łatwo dostrajaj i adaptuj model do swoich unikalnych wymagań za pomocą biblioteki Transformers od Hugging Face lub preferowanego środowiska programistycznego.

Wdrażanie i skalowanie:

- Wprowadź swoje niestandardowe kreacje Gemma 3 na rynek w skali z Vertex AI.

- Uruchamiaj wnioskowanie na Cloud Run z Ollama.

- Rozpocznij pracę z NVIDIA NIMs w NVIDIA API Catalog.

Google DeepMind zachęca deweloperów do eksplorowania potencjału Gemma 3 i dołączenia do rosnącej społeczności Gemmaverse, tworząc nowe, innowacyjne rozwiązania AI dostępne dla wszystkich.

Źródło: blog.google