Naukowcy Apple opracowali przełomową technikę uczenia maszynowego, która może zrewolucjonizować sposób analizy sygnałów mózgowych. Ich najnowsze badanie prezentuje metodę umożliwiającą modelom sztucznej inteligencji poznawanie struktury aktywności elektrycznej mózgu bez konieczności korzystania z oznaczonych danych.

Rewolucja w analizie EEG dzięki samonadzorowaniu

Tradycyjne systemy analizy elektroencefalografii (EEG) wymagają ogromnych ilości ręcznie oznaczonych danych przez ekspertów. Specjaliści muszą identyfikować poszczególne fazy snu, lokalizować początki napadów padaczkowych i oznaczać wiele innych wzorców neuronalnych. Proces ten jest nie tylko czasochłonny, ale również kosztowny.

Czym jest metoda PARS?

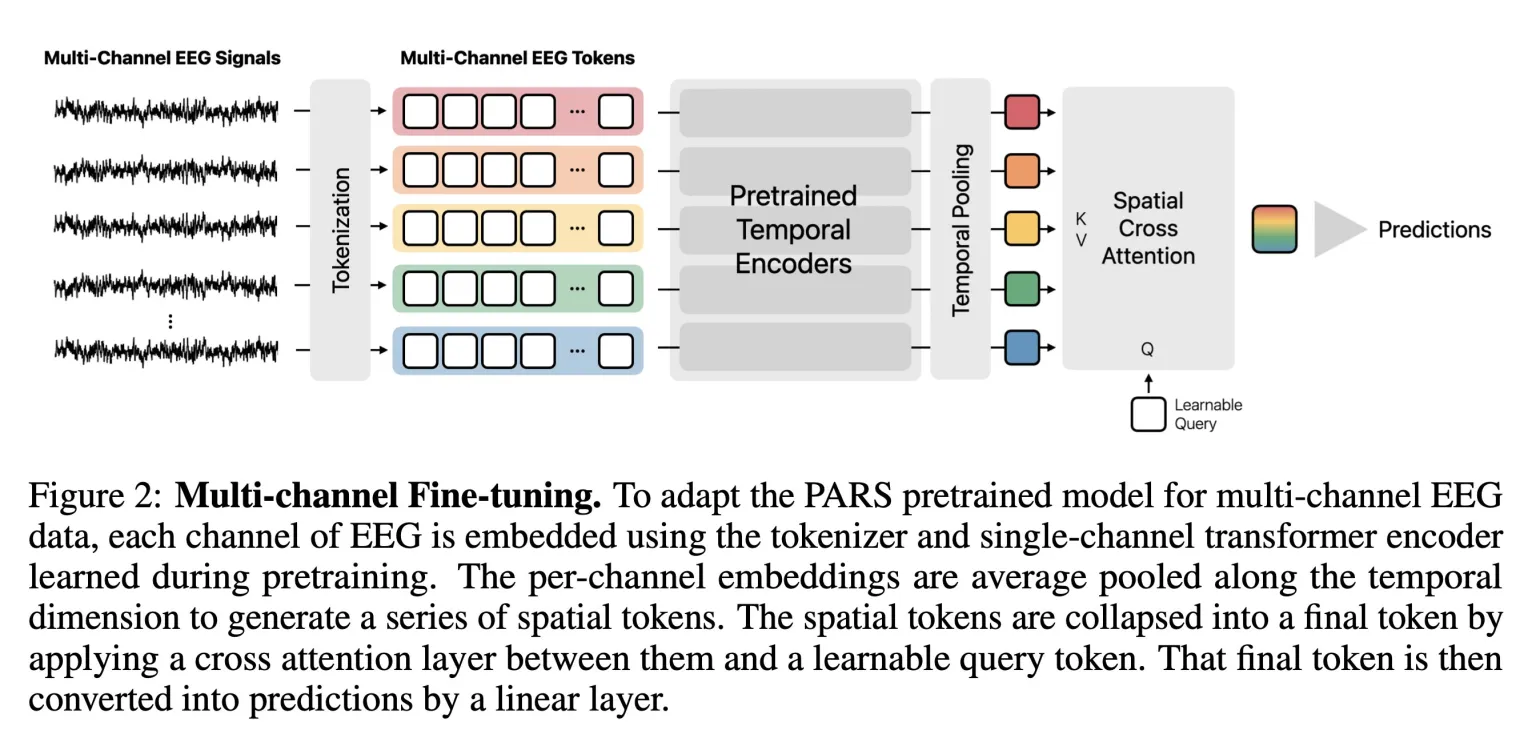

Zespół badawczy Apple wprowadza nowe podejście o nazwie PARS (PAirwise Relative Shift), co można przetłumaczyć jako parami względne przesunięcie. W odróżnieniu od dotychczasowych metod koncentrujących się na rekonstrukcji lokalnych wzorców, system PARS uczy model przewidywać względne odstępy czasowe pomiędzy różnymi segmentami sygnału EEG.

Dlaczego to ważne?

Jak wyjaśniają autorzy badania, uczenie samonadzorowane (self-supervised learning) stanowi obiecujące podejście do pozyskiwania reprezentacji danych EEG bez etykiet. Redukuje to zapotrzebowanie na kosztowne adnotacje niezbędne w aplikacjach klinicznych, takich jak stadia snu czy wykrywanie napadów.

Praktyczne zastosowania i wyniki

Nowa metoda została przetestowana na czterech różnych benchmarkach EEG, demonstrując imponujące możliwości. Model wstępnie wytrenowany techniką PARS osiągnął lepsze lub porównywalne wyniki w trzech z czterech zestawów danych w porównaniu z istniejącymi metodami pretreningu.

Gdzie sprawdzono skuteczność?

Badacze wykorzystali cztery kluczowe zbiory danych: Wearable Sleep Staging (EESM17) dotyczący monitorowania snu, Abnormal EEG Detection (TUAB) do wykrywania nieprawidłowości, Seizure Detection (TUSZ) identyfikujący napady oraz Motor Imagery (PhysioNet-MI) związany z wyobrażeniem ruchu.

Znaczenie danych EESM17

Szczególnie interesujący jest zestaw EESM17, zawierający nocne zapisy od 9 uczestników z wykorzystaniem 12-kanałowego systemu ear-EEG oraz 6-kanałowego systemu skalp-EEG. To właśnie te dane dotyczące noszonego systemu monitorowania snu przykuwają największą uwagę w kontekście potencjalnych zastosowań konsumenckich.

Połączenie z przyszłymi produktami Apple

Chociaż badanie nie wspomina bezpośrednio o żadnych produktach Apple, istnieją wyraźne powiązania z wcześniejszymi patentami firmy. W 2023 roku Apple złożył wniosek patentowy dotyczący „noszonego urządzenia elektronicznego do pomiaru biosygnałów użytkownika”.

Rozwiązanie problemów ear-EEG

Patent Apple szczegółowo opisuje wyzwania związane z urządzeniami ear-EEG, w tym konieczność dopasowania do indywidualnego kształtu ucha użytkownika oraz utrzymania ciągłego kontaktu elektrod ze skórą. Firma proponuje rozwiązanie polegające na umieszczeniu większej liczby czujników w końcówkach AirPods i wykorzystaniu algorytmów do wyboru tych z najlepszą jakością sygnału.

Jak mogłoby to działać?

System opisywany w patencie wykorzystywałby metryki takie jak impedancja, poziom szumu, jakość kontaktu ze skórą oraz odległość między elektrodami aktywnymi i referencyjnymi. Następnie przypisywałby różne wagi do każdej elektrody, łącząc wszystkie sygnały w zoptymalizowany przebieg.

Pomiary biosygnałów mogą być wykorzystane do informowania użytkownika o różnych przypadkach użycia opartych na biosygnałach, takich jak monitorowanie snu lub innych anomalii, na przykład napadów

Perspektywy rozwoju technologii

Połączenie zaawansowanych metod uczenia maszynowego z hardware’em zdolnym do przechwytywania sygnałów neuronalnych otwiera nowe możliwości w dziedzinie urządzeń noszonych. Apple bada zarówno sprzęt do zbierania tych danych, jak i modele AI poprawiające ich późniejszą analizę.

Od badań do produktu

Należy podkreślić, że obecne badanie nie ma formalnego powiązania z wnioskiem patentowym z 2023 roku. Stanowi ono niezależne dochodzenie naukowe sprawdzające, czy model może samodzielnie nauczyć się przewidywać przedziały czasowe między falami mózgowymi z nieoznaczonych danych, wykorzystując pomiary ear-EEG jako część swojego zestawu danych.

Co dalej?

Chociaż nie ma gwarancji, że ta technologia trafi do produktów konsumenckich, równoległe badania Apple nad hardware’em do zbierania danych i algorytmami do ich analizy sugerują strategiczne zainteresowanie tą dziedziną. Decyzja o komercjalizacji tych rozwiązań pozostaje otwarta i zależna od wielu czynników, w tym skuteczności technologii w warunkach rzeczywistych oraz względów regulacyjnych.

Rozwój metody PARS przez Apple pokazuje rosnące znaczenie uczenia samonadzorowanego w analizie sygnałów biomedycznych. Technologia ta może znacząco obniżyć koszty i zwiększyć dostępność zaawansowanej analizy neurologicznej. Jednocześnie badania nad integracją czujników EEG z urządzeniami noszonymi wskazują na długoterminowy kierunek rozwoju, w którym codzienna elektronika może zyskać funkcje monitorowania zdrowia mózgu. Czy doczekamy się AirPods z możliwością śledzenia fal mózgowych? Czas pokaże, ale fundamenty technologiczne są już budowane.