Świat sztucznej inteligencji od lat ściga się w rankingach i benchmarkach, gdzie złożone możliwości modeli są często redukowane do jednej, prostej liczby. Google DeepMind proponuje radykalną zmianę tego paradygmatu. Zamiast pytać „jak dobry jest ten model?”, nowa rama ewaluacji ma pomóc odpowiedzieć na pytanie: „w czym ten model jest naprawdę dobry, a nad czym musi pracować?”. To przejście od oceny do głębokiego zrozumienia zdolności poznawczych systemów AI.

Dlaczego pojedynczy wynik to za mało?

Tradycyjne benchmarki, choć użyteczne, przypominają niekiedy ocenianie człowieka wyłącznie na podstawie wyniku testu IQ. Pomijają całą paletę innych, kluczowych umiejętności. Eksperci z DeepMind wskazują, że dążenie do sztucznej inteligencji ogólnej (AGI) wymaga znacznie bardziej subtelnych narzędzi pomiaru. Ich nowa, wielowymiarowa rama ma na celu uchwycenie tej złożoności poprzez ocenę systemów AI na podobieństwo ludzkich zdolności poznawczych.

Dziesięć filarów inteligencji

Sercem proponowanego podejścia jest taksonomia obejmująca dziesięć kluczowych wymiarów poznawczych. Każdy z nich odpowiada fundamentalnej cesze ludzkiego umysłu, którą warto mierzić w systemach AI:

- Percepcja: Zdolność do interpretowania informacji sensorycznych, np. ze świata wizualnego lub dźwięków.

- Generowanie: Umiejętność tworzenia spójnych i sensownych treści, takich jak tekst, obrazy czy kod.

- Uwaga (Attention): Skupianie się na istotnych danych przy jednoczesnym ignorowaniu szumu i nieistotnych szczegółów.

- Uczenie się: Zdolność do przyswajania nowej wiedzy i adaptowania się do nowych informacji w czasie.

- Pamięć: Retencja i przywoływanie wcześniej zdobytych informacji w odpowiednim momencie.

- Rozumowanie: Logiczne wnioskowanie i rozwiązywanie problemów na podstawie dostępnych danych.

- Meta-poznanie: Świadomość własnych procesów myślowych i możliwość ich regulacji (np. ocena pewności swojej odpowiedzi).

- Funkcje wykonawcze: Planowanie, podejmowanie decyzji i ukierunkowane na cel działanie.

- Rozwiązywanie problemów: Identyfikowanie i wdrażanie rozwiązań dla złożonych, nieznanych wcześniej wyzwań.

- Poznanie społeczne: Rozumienie interakcji międzyludzkich, intencji, emocji i norm społecznych.

Dzięki takiemu ujęciu, system AI może otrzymać szczegółowy profil, który pokaże, że np. błyszczy w rozumowaniu i generowaniu kodu, ale ma deficyty w obszarze inteligencji społecznej czy samoświadomości. To mapa silnych i słabych stron, a nie tylko suchy wynik.

Trójetapowy proces oceny

Aby przełożyć teoretyczną taksonomię na praktyczne narzędzie, badacze opracowali strukturalny, trzyczęściowy protokół ewaluacyjny. Ma on zapewnić przejrzystość i dostarczyć konkretnych informacji dla twórców AI.

Od testów po wizualizację

Proces zaczyna się od oceny poznawczej. Systemy AI są testowane przy użyciu specjalnie zaprojektowanych, niepublicznych zadań, które celują w poszczególne zdolności. To minimalizuje ryzyko, że model „widział” już dane treningowe, co zwiększa wiarygodność wyników.

Następnie wyniki poddawane są porównaniu z ludzkimi bazami. Wydajność AI jest mierzona względem reprezentatywnej grupy ludzi, co ustala jasny punkt odniesienia w drodze ku AGI. Pozwala to stwierdzić nie tylko, czy AI radzi sobie z zadaniem, ale jak jej umiejętności plasują się na tle ludzkich.

Ostatni etap to tworzenie profilów poznawczych. Zebrane dane są wizualizowane za pomocą wykresów radarowych, które w intuicyjny sposób przedstawiają wydajność modelu we wszystkich dziesięciu wymiarach. Taki diagram od razu ukazuje nierówny, „postrzępiony” frontier rozwoju AI – obszary, w których system przewyższa człowieka, oraz te, w których wciąż pozostaje w tyle.

Nierozwiązane wyzwania i współpraca

Mimo że nowa rama stanowi znaczący postęp, jej twórcy otwarcie przyznają, że nie rozwiązuje wszystkich problemów związanych z oceną AGI. Pozostają istotne luki wymagające dalszych badań.

Granice obecnej metody

Do kluczowych wyzwań, które framework obecnie pomija, należą: szybkość odpowiedzi (krytyczna w aplikacjach czasu rzeczywistego), tendencje behawioralne (jak awersja do ryzyka czy zgodność z wartościami), kreatywność (trudna do zdefiniowania i zmierzenia) oraz problem odróżnienia wrodzonej inteligencji modelu od jego umiejętności korzystania z zewnętrznych narzędzi podczas testu.

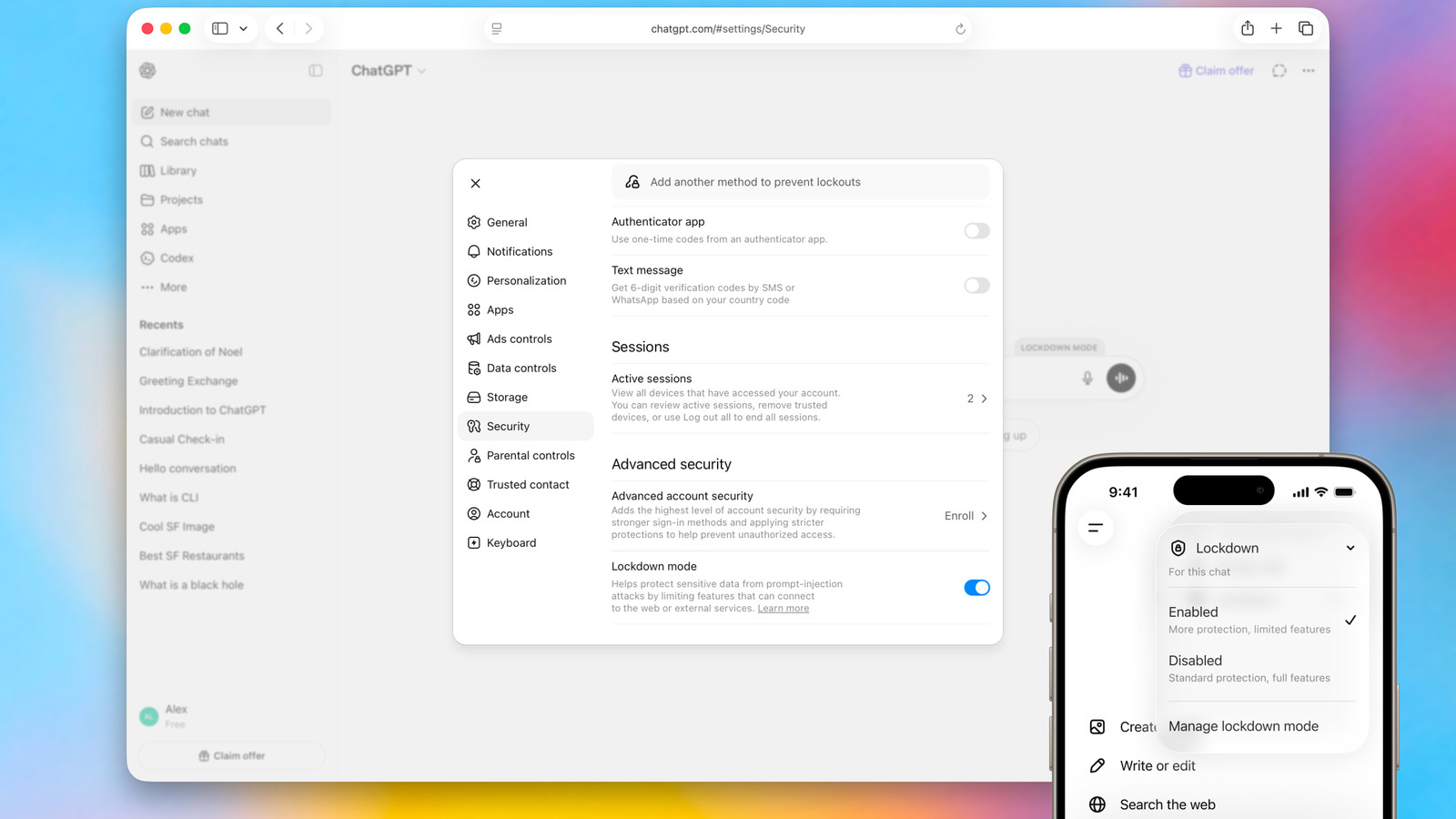

Hakaton za 200 000 dolarów

Aby stawić czoła tym wyzwaniom i przyspieszyć rozwój nowych metod testowania, Google DeepMind uruchomił inicjatywę opartą na współpracy społeczności. To hackathon na platformie Kaggle z pulą nagród 200 000 dolarów. Jego uczestnicy są zachęcani do opracowania innowacyjnych rozwiązań do oceny pięciu wybranych wymiarów: uczenia się, meta-poznania, uwagi, funkcji wykonawczych i poznania społecznego.

Inicjatywa ma na celu przekształcenie subiektywnych twierdzeń na temat postępu w AGI w mierzalne, oparte na nauce oceny.

To crowdsourcingowe podejście ma za zadanie zgromadzić kreatywne pomysły od globalnej społeczności badaczy AI, czyniąc proces ewaluacji bardziej otwartym i kompleksowym.

Ku wspólnemu językowi AGI

Wprowadzenie tej ramy ewaluacji następuje w kluczowym momencie, gdy wiodące laboratoria AI wciąż spierają się o samą definicję sztucznej inteligencji ogólnej. Brak powszechnie przyjętej definicji utrudnia porównywanie postępów między różnymi systemami. Wielowymiarowe podejście DeepMind ma szansę stać się takim wspólnym językiem – znormalizowaną, przejrzystą metodą opisu i pomiaru zdolności AI.

W dłuższej perspektywie, to nie rankingi, ale właśnie takie szczegółowe profile poznawcze mogą kształtować przyszłość badań nad AGI. Pomogą one kierować rozwojem systemów w sposób odpowiedzialny, ukierunkowany na eliminację konkretnych słabości i zrozumienie prawdziwej natury ich „inteligencji”. To krok od gonienia za punktami w tabeli do budowania głębokiego zrozumienia maszynowego umysłu.