W świecie sztucznej inteligencji od dawna panowało przekonanie, że większy rozmiar modelu przekłada się na lepsze wyniki. Google kwestionuje tę zasadę, prezentując Gemmę 4 – system, który przy zaledwie 2,3 miliarda parametrów osiąga poziom wydajności porównywalny z modelami liczącymi ich 70 miliardów. Ta rewolucyjna wydajność idzie w parze z minimalnymi wymaganiami sprzętowymi, umożliwiając działanie nawet na zwykłych smartfonach w trybie offline. Otwiera to nowy rozdział w dostępie do zaawansowanego AI, niezależnego od chmury i potężnych centrów danych.

Czym wyróżnia się Gemma 4?

Nowy model od Google nie próbuje konkurować z największymi systemami poprzez rozmiar, lecz poprzez inteligentną architekturę i praktyczne zastosowania. Jego projekt od początku zakładał działanie w środowiskach o ograniczonych zasobach, co zaowocowało kilkoma kluczowymi cechami.

Dostępność i niezależność od infrastruktury

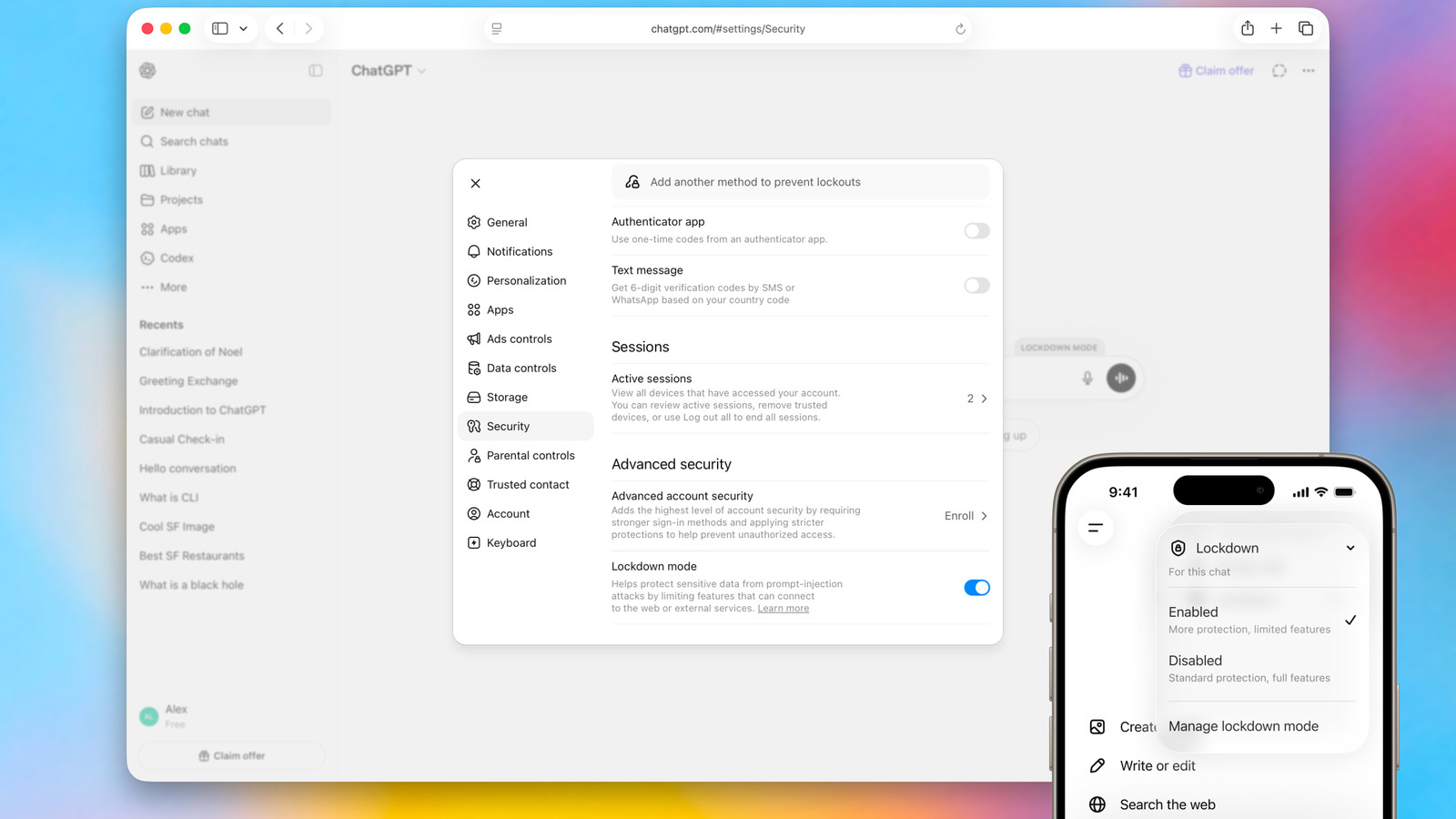

Gemma 4 została wydana na licencji open source Apache 2.0. Oznacza to, że programiści mogą swobodnie korzystać z modelu, modyfikować go i wdrażać we własnych projektach bez ponoszenia kosztów licencyjnych. To znacznie przyspiesza innowacje i pozwala na tworzenie spersonalizowanych rozwiązań AI. Jednak prawdziwym game-changerem jest możliwość pracy offline. Model nie potrzebuje stałego połączenia z internetem ani zewnętrznych serwerów, co ma fundamentalne znaczenie dla prywatności danych i zastosowań w miejscach o słabej łączności.

Wydajność w kompaktowej formie

Mimo niewielkiej liczby parametrów, Gemma 4 generuje wyniki, które dotąd były domeną znacznie większych systemów. Jej efektywność przekłada się na konkretne korzyści: model potrzebuje mniej niż 1,5 GB pamięci RAM do działania. Dzięki temu może być uruchamiany na popularnych telefonach, laptopach czy innych urządzeniach brzegowych (edge devices), bez inwestycji w drogi, specjalistyczny sprzęt.

Zdolność do funkcjonowania bez połączenia internetowego czyni ją idealną dla środowisk zdalnych lub aplikacji wrażliwych na kwestie prywatności, gdzie bezpieczeństwo danych ma pierwszorzędne znaczenie.

Innowacje techniczne napędzające możliwości modelu

Osiągnięcia Gemmy 4 nie są przypadkowe, lecz wynikiem kilku zaawansowanych rozwiązań inżynieryjnych, które optymalizują procesy wnioskowania i przetwarzania informacji.

Architektura multimodalna i zaawansowane wnioskowanie

Model nie ogranicza się do tekstu. Jego multimodalna konstrukcja pozwala na płynne przetwarzanie danych wizyjnych i dźwiękowych. Oznacza to, że może analizować obrazy, rozpoznawać mowę i rozumieć język naturalny w ramach jednego, zintegrowanego systemu. Kluczową rolę odgrywa także tzw. łańcuch rozumowania (reasoning chain), który poprawia logiczną spójność generowanych odpowiedzi. Dzięki temu model popełnia mniej błędów i lepiej radzi sobie ze złożonymi, wieloetapowymi zadaniami.

Optymalizacje zwiększające efektywność

Jedną z technik stojących za wydajnością Gemmy 4 są tzw. osadzenia warstwowe (per-layer embeddings). To optymalizacja, która usprawnia wewnętrzne procesy rozumowania modelu, pozwalając mu osiągać trafne wnioski przy mniejszym zużyciu mocy obliczeniowej. Ponadto, system dysponuje rozległym oknem kontekstowym o długości 128 tysięcy tokenów, co umożliwia analizę bardzo długich dokumentów lub rozbudowanych rozmów z zachowaniem spójności.

Praktyczna wydajność i obszary do rozwoju

W testach benchmarkowych Gemma 4 potwierdza, że jest narzędziem nie tylko teoretycznie wydajnym, ale i praktycznie użytecznym w wielu dziedzinach.

Mocne strony i wyniki testów

Model wykazuje się szczególną siłą w zadaniach wymagających precyzyjnego rozumowania. Na przykład, w benchmarku matematycznym AIME 2026 osiągnął wynik 42,5%, co świadczy o solidnych umiejętnościach rozwiązywania problemów. Bardzo dobrze radzi sobie także z wykorzystaniem narzędzi, takim jak optyczne rozpoznawanie znaków (OCR) czy ekstrakcja danych z dokumentów. Kolejną ogromną zaletą jest wsparcie dla ponad 140 języków, co czyni go niezwykle wartościowym narzędziem w globalnych projektach.

Wyzwania i ograniczenia

Jak każda technologia, Gemma 4 ma swoje słabsze strony. Testy wskazują, że generowanie kodu nie jest jej najmocniejszą stroną. Podczas ewaluacji zaobserwowano również sporadyczne niedokładności w rozpoznawaniu elementów na obrazach oraz w stosowaniu złożonych struktur gramatycznych. Istnieją też ograniczenia platformowe – brak natywnych powiązań z frameworkiem MLX utrudnia obecnie integrację z aplikacjami na system iOS. Ponadto, w zadaniach wymagających wysokiej kreatywności, jak projektowanie stron czy generowanie artystycznych treści, może ustępować wyspecjalizowanym, większym modelom.

Perspektywy rozwoju lekkiego AI

Przyszłość Gemmy 4 wydaje się obiecująca, głównie dzięki jej otwartoźródłowemu charakterowi. Aktywna społeczność programistów ma szansę przyczynić się do usunięcia obecnych ograniczeń, na przykład poprzez opracowanie bibliotek umożliwiających szerszą integrację platformową. Prace nad poprawą jakości w zadaniach związanych z kodowaniem czy kreatywnością już trwają. Ten model rozwoju przez współpracę może przyspieszyć ewolucję Gemmy 4 w kierunku jeszcze bardziej uniwersalnego narzędzia.

Premiera Gemmy 4 stanowi wyraźny sygnał, że branża sztucznej inteligencji wkracza w fazę dojrzałości, gdzie priorytetem staje się nie tylko surowa moc, ale także efektywność, dostępność i praktyczność. Udowadnia, że zaawansowane AI może działać tam, gdzie jest to najbardziej potrzebne – bezpośrednio na urządzeniach końcowych użytkowników, zachowując ich prywatność i niezależność od zewnętrznej infrastruktury. To może być początek nowego trendu, w którym „mniejsze i lepsze” stanie się równie ważne jak „większe i potężniejsze”.