W ostatnich dniach media społecznościowe obiegła seria niezwykłych fotografii. Przedstawiały one Elona Muska, Marka Zuckerberga i innych szefów gigantów technologicznych w prozaicznych sceneriach – ciasnych mieszkaniach, parkingach McDonald’s czy podczas posiłku na ziemi. Choć absurdalny kontekst mógł budzić wątpliwości, wiele osób uznało te wizerunki za autentyczne. Okazały się one jednak wytworem sztucznej inteligencji, co potwierdza nowe narzędzie od Google.

Nowy sposób na weryfikację obrazów w sieci

Podczas gdy większość dostępnych publicznie detektorów obrazów AI charakteryzuje się niską wiarygodnością, Google wprowadził SynthID właśnie rozwiązanie, które może stanowić przełom. Mowa o funkcji sprawdzania niewidzialnych znaków wodnych SynthID, która stała się dostępna dla każdego użytkownika platformy Gemini. To odpowiedź firmy na rosnący problem dezinformacji wizualnej.

Dlaczego dotychczasowe detektory zawodziły?

Eksperci od dawna wskazywali, że powszechnie dostępne w sieci narzędzia do identyfikacji treści generowanych przez AI często dają błędne wyniki. Przykładowo, zadawanie pytań na temat autentyczności obrazów asystentowi Grok na platformie X prowadziło do licznych pomyłek, niekiedy o komicznym charakterze. Problem polegał na tym, że algorytmy nie radziły sobie z poprawną klasyfikacją zaawansowanych generacji.

Jak działa technologia SynthID od Google?

SynthID to niewidoczny dla ludzkiego oka znak wodny, osadzany bezpośrednio w strukturze pikseli każdego obrazu stworzonego za pomocą narzędzi Google do generowania AI. Chociaż technologia ta istnieje od około dwóch lat, dopiero od kilku dni zwykli użytkownicy mogą samodzielnie weryfikować jego obecność.

Proces weryfikacji krok po kroku

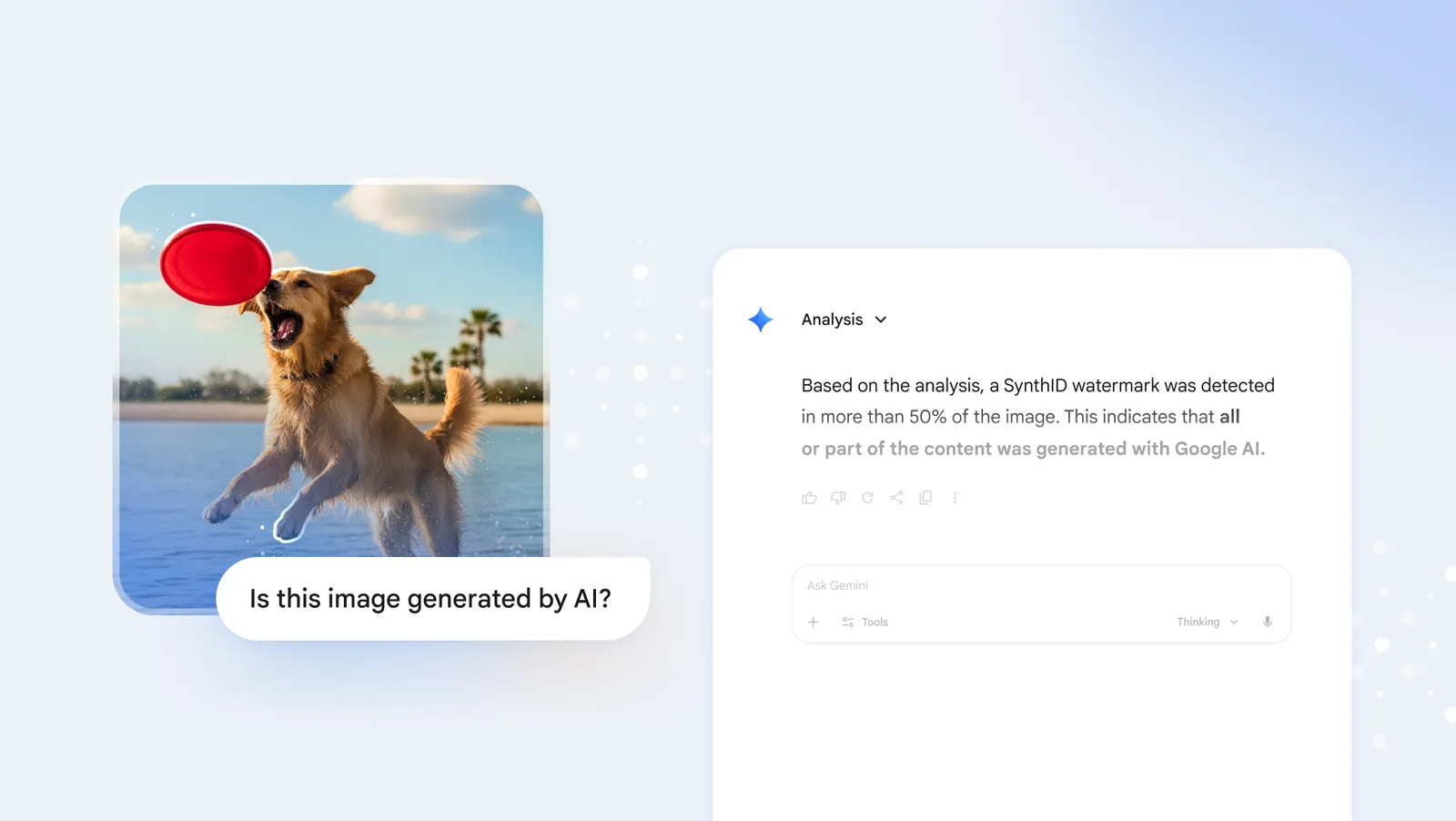

Aby sprawdzić pochodzenie obrazu, wystarczy przesłać go do aplikacji Gemini i zadać pytanie takie jak „Czy to zostało stworzone przez AI Google?” lub „Czy ten obraz jest generowany przez sztuczną inteligencję?”. System analizuje plik pod kątem obecności wodnemarku SynthID, a następnie udziela odpowiedzi wraz z dodatkowym kontekstem dotyczącym napotkanej treści.

Gemini sprawdza obecność znaku wodnego SynthID i wykorzystuje własne rozumowanie, aby zwrócić odpowiedź, która dostarcza więcej kontekstu na temat treści, na które trafiasz online.

Ograniczenia metody

Należy pamiętać, że narzędzie jest najbardziej skuteczne w przypadku obrazów powstałych przy użyciu produktów Google, takich jak Nano Banana Pro. Jeśli obraz został wygenerowany za pomocą innych systemów AI, Gemini może nie być w stanie jednoznacznie określić jego pochodzenia. To właśnie ograniczenie stanowi główny powód, dla którego Google zdecydował się na udostępnienie funkcji detekcji szerszej publiczności w obecnym momencie.

Wiralowe fałszywki i nowa rzeczywistość mediów społecznościowych

Jedno ze zdjęć, które zdobyło szczególną popularność, przedstawiało grupę prezesów – Muska, Jensena Huanga z Nvidii, Sundara Pichaia z Google, Tima Cooka z Apple, Jeffa Bezosa z Amazon, Satyę Nadellę z Microsoftu i Marka Zuckerberga z Meta – stojących razem w małym mieszkaniu. Obraz ten zgromadził blisko 9 milionów wyświetleń na platformie X, zanim trafił na inne serwisy, takie jak Bluesky.

Różne wersje jednej generacji

Kolejne warianty tego samego motywu ukazywały tych samych mężczyzn na parkingu, czasem z dołączoną postacią Sama Altmana z OpenAI. W niektórych ujęciach Musk pojawiał się z cygarem, w innych zaś grupa jadła posiłek z McDonald’s na ziemi, z Cybertruckiem w tle. Przepuszczenie któregokolwiek z tych obrazów przez Gemini potwierdza, że wszystkie zawierają znak wodny SynthID, co jednoznacznie wskazuje na ich syntetyczne pochodzenie.

Nie tylko tech CEO – politycy też są na celowniku

Problem nie dotyczy wyłącznie wizerunków osobistości ze świata technologii. Inne wiralowe zdjęcie, przedstawiające byłego prezydenta Donalda Trumpa w kompromitującej sytuacji z Billem Clintonem, również zostało zidentyfikowane przez Gemini jako wytwór generatora obrazów AI Google. To pokazuje skalę potencjalnego wykorzystania tej technologii do dezinformacji.

Zdrowy rozsądek w erze syntetycznych mediów

Eksperci podkreślają, że nawet zaawansowane narzędzia detekcyjne nie zastąpią krytycznego myślenia. Jeśli obraz wydaje się zbyt absurdalny, by był prawdziwy, prawdopodobnie taki jest. Przykładowo, czy realistyczne jest, aby Elon Musk i Sam Altman spotykali się razem na parkingu, biorąc pod uwagę ich publiczne konflikty? Taki scenariusz wydaje się mało prawdopodobny.

Narzędzie, a nie panaceum

Choć Gemini nie będzie w stanie zidentyfikować z całą pewnością każdego obrazu AI, to jeśli po przesłaniu pliku system poinformuje o obecności wodnemarku SynthID, możemy być pewni, że obraz nie jest autentyczny. W obecnym ekosystemie mediów społecznościowych fałszywe wizerunki będą nadal wszechobecne, ale Google dał zwykłym użytkownikom nowe narzędzie do identyfikacji przynajmniej części z nich.

W nadchodzących latach rozpoznawanie treści generowanych przez sztuczną inteligencję stanie się coraz trudniejsze. Nowa funkcja w Gemini to krok w kierunku większej transparentności, ale nie rozwiązuje ona problemu w pełni. W erze głębokich fałszerstw połączenie zdrowego rozsądku z dostępnymi technologiami weryfikacyjnymi stanie się kluczową umiejętnością każdego świadomego użytkownika internetu.